Nvidia 推出采用Blackwell架构的新系统

Nvidia 推出采用Blackwell架构的新系统

作者:开源爱好者

来源:

|

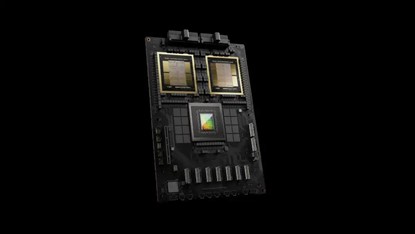

英伟达发布了由Blackwell驱动的新系统,该公司表示,这些系统将允许企业 “建立AI工厂和数据中心,以推动下一波生成式人工智能的突破”。在台北电脑展上发布的这些系统拥有单个或多个 GPU、x86 或基于 Grace 的处理器,以及风冷或液冷系统,以满足应用需求。

英伟达还宣布,去年在台北电脑展上发布的 Nvidia MGX 模块化参考设计平台现在支持 Blackwell 产品。英伟达在展会前的媒体发布会上表示,由于采用了Blackwell架构,新的Nvidia GB200 NVL2平台(3月份推出的GB200 NVL72的缩小版)的数据处理速度将提高18倍,能效比使用x86 CPU提高8倍。 Blackwell 是英伟达在 3 月份的 GTC 大会上发布的,是 Nvidia Hopper GPU 架构的后续产品,而 Grace 则是其基于 Arm 的 CPU 设计。GB200 系统包含 Blackwell GPU 和 Grace CPU。 英伟达加速计算总监Dion Harris在发布会上表示,GB200 NVL2平台使数据中心进入了GenAI时代。 该公司表示,现在又有十家合作伙伴销售采用Blackwell架构的系统。华擎Rack、华硕、技嘉、英格拉思、英业达、和硕、QCT、超微、纬创和Wiwynn将使用英伟达的GPU和网络技术提供云、内部部署、嵌入式和边缘AI系统。 Info-Tech Research Group人工智能市场研究总监Thomas Randall在一封电子邮件中表示:“英伟达已经主导并塑造了人工智能创新所需的基础架构和基础设施。”今天宣布的消息强化了这一说法,英伟达技术将嵌入计算机制造、AI工厂的核心,并使开发人员能够广泛使用生成式人工智能。” 性能焦虑 Forrester高级分析师Alvin Nguyen表示,然而,这种性能提升将为数据中心经理带来新的担忧。 “我预计,采用Blackwell架构的系统将成为首选的AI加速器,就像之前的英伟达加速器一样,”Nguyen在一封电子邮件中说,“更高功率的芯片将需要液体冷却,这将迫使数据中心市场发生变化。但是,并非所有的数据中心都能更新,能提供支持这些系统所需的电力和水。这将推动数据中心升级、新建数据中心、使用合作伙伴(主机托管、云服务)以及采用竞争对手功耗较低的加速器等方面的支出。” 在网络方面,英伟达宣布去年在Computex上发布的专为基于以太网的AI云设计的加速网络平台Spectrum-X现已全面上市。此外,网络副总裁Amit Katz表示,英伟达正在加快更新速度:每年都将发布新产品,以提供更高的带宽和端口,并增强软件功能集和可编程能力。 Nguyen指出,该平台架构的DPU针对南北向流量进行了优化,而SuperNIC则针对东西向、GPU到GPU的流量进行了优化,这种架构是合理的,但确实增加了复杂性。他说:“这是一种补充解决方案,有助于推动超级计算平台和AI工厂等大型人工智能解决方案的采用。”使用这种方法会增加复杂性,但它最终会帮助那些正在实施大规模人工智能基础设施的英伟达客户。 他补充说:“英伟达正在用另一种技术标准来推动人工智能基础设施的发展,这种技术标准最终将成为专有技术,但他们需要这样做才能在竞争中保持领先地位”。 |

商情

商情